本文介绍了一种基于二维半导体铁电场效应晶体管(FeFET)的无索引稀疏神经网络(SPNN)硬件架构。通过结合硬件设计、算法优化和训练调度,实现了在75%稀疏性下98.4%的准确率,显著降低了稀疏神经网络在延迟和能耗方面的性能损耗。论文详细阐述了该架构的设计原理、实现方法和性能评估。

随着人工智能技术的发展,构建高效、低能耗的神经网络成为当前研究热点。受生物大脑启发,稀疏神经网络通过模拟大脑中突触的动态稀疏性,提高了能量利用效率。然而,现有稀疏神经网络的实现往往依赖于外部索引,引入了额外的能耗和延迟。

本研究提出了一种无索引稀疏神经网络硬件架构,结合二维半导体材料和FeFET技术实现高效、低能耗的稀疏计算。通过硬件设计、算法优化和训练调度的协同优化,实现了在75%稀疏性下98.4%的准确率。

研究使用两个非易失性铁电场效应晶体管(FeFET)作为数字稀疏性和模拟权重的基本构建模块。采用化学气相沉积(CVD)生长的二维二硫化钼(MoS₂)作为沟道材料。通过调整铁电层厚度和铁电-介电面积比,优化稀疏性和权重FeFET的存储特性。

研究提出了一种向量化近似更新算法(VAU),通过向量级操作来近似传统的细胞级梯度更新,提高了稀疏神经网络的训练效率。同时,采用渐进式更新调度策略,通过预训练、剪枝、过度剪枝和重生等多个阶段,逐步优化稀疏神经网络的稀疏性和准确性。

为了方便各位同学交流学习,解决讨论问题,我们建立了一些微信群,作为互助交流的平台。2.告知:姓名-课题组-研究方向,由编辑审核后邀请至对应交流群(生长,物性,器件);欢迎投稿欢迎课题组投递中文宣传稿,免费宣传成果,发布招聘广告,具体联系人:13162018291(微信同号)

【研究背景】

随着人工智能(AI)技术的飞速发展,构建高效、低能耗的神经网络成为当前科技领域的研究热点。传统的人工神经网络(ANN)普遍采用密集连接的方式,即每个神经元都与其他所有神经元相连接,这种方式虽然能够捕捉到数据中的复杂关系,但也导致了计算资源和能耗的极大浪费。尤其是在处理大规模数据集和复杂任务时,密集神经网络的计算复杂度和能耗问题变得尤为突出。

受生物大脑启发,稀疏神经网络(SPNN)通过模拟大脑中突触的动态稀疏性,实现了更加高效的能量利用。在生物大脑中,突触连接并不是固定的,而是通过动态剪枝和再生长过程不断优化,以适应不同的环境和任务需求。这种稀疏性不仅减少了不必要的计算,还提高了信息处理的效率和准确性。然而,现有稀疏神经网络的实现往往依赖于外部索引来管理稀疏性,即在内存中存储一个额外的索引表来指示哪些突触是活跃的,哪些是被剪枝的。这种方式虽然能够实现稀疏计算,但也引入了额外的能耗和延迟,尤其是在稀疏度较高的情况下。

为了克服这一挑战,研究者们开始探索无外部索引的稀疏神经网络架构。这种架构通过将稀疏性信息直接存储在神经网络内部,消除了对外部索引的依赖,从而实现了更加高效、低能耗的稀疏计算。然而,实现这种架构面临诸多技术难题,如如何有效地在硬件中实现稀疏性存储和更新,如何设计高效的稀疏神经网络算法等。近日,南京大学王欣然教授团队联合南京邮电大学于志浩教授团队在国际顶级期刊Nature electronic上发文提出了一种基于二维半导体铁电场效应晶体管(FeFET)的索引无关稀疏神经网络(SPNN)架构。二维半导体材料,如二硫化钼(MoS2),因其独特的物理和化学性质,如原子级厚度、高迁移率、低功耗等,成为实现高效电子器件和神经形态计算的理想选择。而FeFET作为一种非易失性存储器件,能够在断电后保持数据不丢失,为稀疏性信息的存储提供了可能。通过结合二维半导体材料和FeFET技术,本研究旨在实现一种无外部索引、高效、低能耗的稀疏神经网络架构,以推动人工智能技术的发展。

【研究方法】

1.硬件设计

无索引突触单元设计

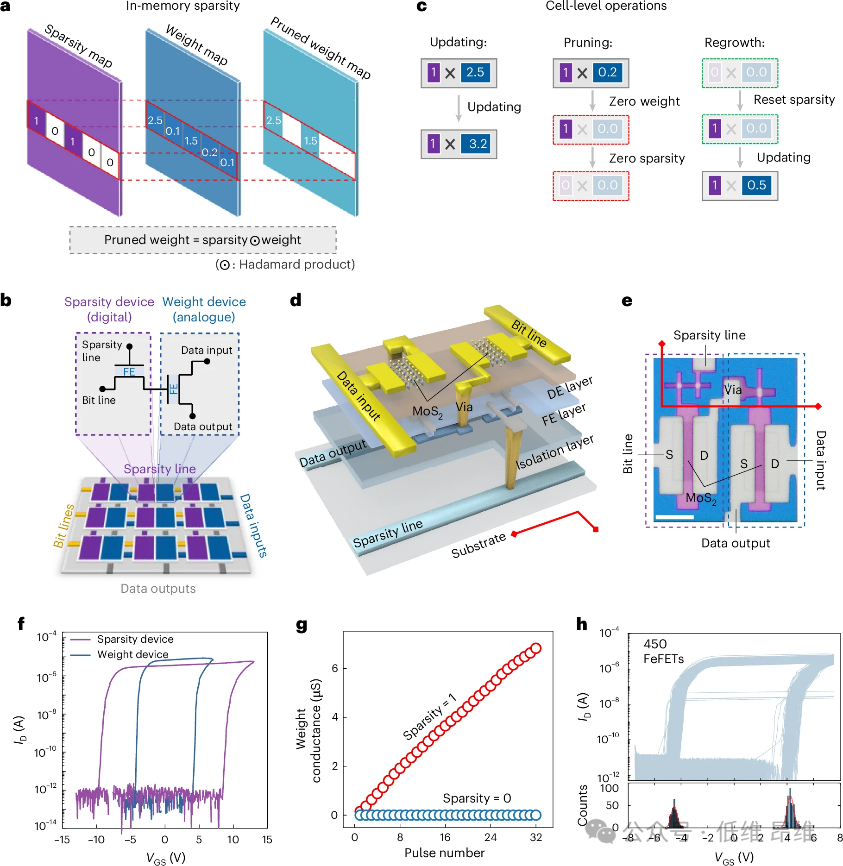

使用两个非易失性铁电场效应晶体管(FeFET)作为数字稀疏性和模拟权重的基本构建模块。稀疏性FeFET存储稀疏性信息(‘0’或‘1’),权重FeFET存储模拟权重值。通过Hadamard乘积(元素级矩阵乘法)实现稀疏神经网络的计算。采用化学气相沉积(CVD)生长的二维二硫化钼(MoS₂)作为沟道材料,氧化铪锆(HfₓZr₁₋ₓO₂,HZO)作为栅极介电层。通过调整铁电层厚度和铁电-介电面积比,优化稀疏性和权重FeFET的存储特性。

阵列设计

阵列结构--设计一个25×18的伪交叉阵列,每个单元包含一个稀疏性FeFET和一个权重FeFET。阵列包含位线、稀疏性线、数据输入线和数据输出线,用于单元间的互联。

2. 算法优化

向量化近似更新算法(VAU)--将传统的M×N细胞级梯度近似为M+N个向量级梯度,通过最小二乘法求解向量操作数(OP),使得通过辅助矩阵A计算出的权重更新矩阵ΔW'尽可能接近通过反向传播得到的准确权重更新矩阵ΔW。通过计算ΔW和ΔW'的均方误差(MSE)来评估VAU的精度。结果表明,在稀疏性超过50%的情况下,VAU引入的误差小于一个权重状态,对于典型的稀疏性(商业模型通常为90%),该误差可忽略不计。

3.训练调度优化

渐进式更新调度

在软件上进行10个epoch的预训练,使用L1正则化将权重推向零附近,获得更高的稀疏性。在硬件上进行多次剪枝操作,剪枝比例逐渐增加,同时采用VAU进行权重更新,保持网络稳定性。在剪枝达到一定程度后(如75%),进行过度剪枝操作,观察网络准确性的下降。随后通过重生策略选择性地恢复一些重要的权重,提高网络准确性。从单元级到训练级和调度级的全面优化是实现高性能无索引SPNN的关键。通过结合硬件创新、算法优化和训练调度,实现了在75%稀疏性下98.4%的准确率。

4. 仿真与性能评估

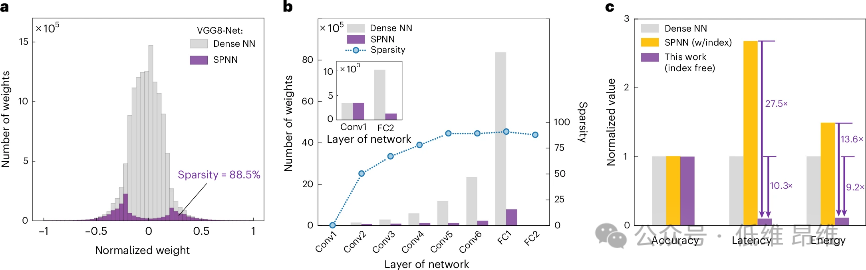

使用DNN+NeuroSim v.2.1仿真平台对VGG8-Net进行仿真,评估无索引SPNN的性能。与密集神经网络和带外部索引的SPNN相比,无索引SPNN在准确性上损失最小。与密集神经网络相比,无索引SPNN在延迟和能耗上分别降低了27.5倍和13.6倍;与带外部索引的SPNN相比,分别降低了10.3倍和9.2倍。

【高亮成果】

1.无索引稀疏神经网络硬件架构

本文首次提出了一种无索引稀疏神经网络硬件架构,通过将稀疏性信息存储在突触单元内部,实现了无需外部索引的稀疏计算。这种架构极大地减少了稀疏计算过程中的能量消耗和延迟,为稀疏神经网络的高效实现提供了可能。

2.高精度向量化近似更新算法

开发了一种向量化近似更新算法(VAU),通过向量级操作来近似传统的细胞级梯度更新,显著提高了稀疏神经网络的训练效率。该算法在保持高精度的同时,大幅降低了计算复杂度,使得稀疏神经网络能够在硬件上实现快速、稳定的训练。

3.渐进式更新调度策略

提出了一种渐进式的更新调度策略,通过预训练、剪枝、过度剪枝和重生等多个阶段,逐步优化稀疏神经网络的稀疏性和准确性。这种策略不仅能够有效地提高网络的稀疏性,还能在剪枝过程中保持网络的稳定性,最终实现了在75%稀疏性下98.4%的准确率。

4.大规模网络仿真与性能评估

使用DNN+NeuroSim仿真平台对VGG8-Net等大型神经网络进行了仿真,评估了无索引稀疏神经网络在准确性、延迟和能耗等方面的性能。结果表明,与密集神经网络和带外部索引的稀疏神经网络相比,无索引稀疏神经网络在保持高准确性的同时,显著降低了延迟和能耗。成功地在硬件上实现了无索引稀疏神经网络,并通过实验验证了其性能和可行性。实验结果表明,该硬件架构能够有效地执行稀疏计算,实现高精度的神经网络推理和训练。

【论文插图】

图1 | NNs中的动态稀疏性。a、大脑皮层生物突触密度的衰老曲线。b、c、生物神经网络的经典模型(b)和动态模型(c)的说明。d、密集神经网络和SPNN的典型权重分布。e、具有外部存储器索引的SPNN的训练进度。索引过程在能量、带宽(BW)和芯片面积方面引入了额外的成本。f、在CIFAR-10数据集上模拟VGG8-Net网络训练期间的权重、能量和延迟分布(约1300万个参数)。经参考文献2 Harry T.Chugani许可,对a小组进行了改编。

图2|无索引突触细胞和装置特征。a、内存稀疏性的稀疏计算过程。修剪后的权重图是通过稀疏性(数字)的哈达玛积和原始权重图(模拟)获得的,原始权重图表示元素矩阵乘法。b、双FeFET单元电池和交叉矩阵阵列的设计。c、解释无索引单元格的基本操作。d、无索引单元集成过程的3D图示。横截面结构的分割线以红色绘制。DE,电介质;FE,铁电体。e、晶胞的光学显微图像。S、源极;D、漏极。比例尺,10μm。f、典型稀疏和重量FeFET的开关特性。ID,漏极电流;VGS,栅极到源极电压。g、稀疏性修饰的无指数突触细胞的多态特性。h、一个阵列中所有450个重量FeFET的开关特性及其开关电压的统计正态分布。正负Vth的平均值分别为4.24 V和-4.52 V,标准差分别为0.25 V和0.23 V。记忆窗口的平均值和标准差分别为8.76 V和0.16 V。

图3|通过VAU和修剪调度进行软硬件协同优化。a、定制MSNet的结构。从EMNIST数据集中随机选择了五类手写字母s–p–a–r–s–e,每类50幅图像。Conv1和Conv2是提取特征的第一和第二卷积层;池化是指减少特征空间维度的池化层;FC是用于分类的全连接层。

图3|通过VAU和修剪调度进行软硬件协同优化。a、定制MSNet的结构。从EMNIST数据集中随机选择了五类手写字母s–p–a–r–s–e,每类50幅图像。Conv1和Conv2是提取特征的第一和第二卷积层;池化是指减少特征空间维度的池化层;FC是用于分类的全连接层。

此外,方形特征的边长和深度用孤立的数字标记,核的大小标记为“5×5”。b,制造的器件阵列和功能区的扫描电镜图像。Conv1区、Conv2区和FC区突出显示。比例尺,200微米。c、渐进式修剪调度流程图。d、e,VAU算法的矢量原理(d)和近似原理(e)的说明(详见扩展数据图5和方法)。M和N分别代表被测单元阵列的行号和列号,也是行和列的操作号。由于单元阵列的伪交叉开关特性,可以将行操作次数减少到一次。MSE,均方误差;w、重量;W、 权重矩阵;ΔW,重量变化;OP,一组用于更新权重的运算符;A、 辅助矩阵,用于建立权重更新方程。f、 软件-硬件协同优化的整体方法。

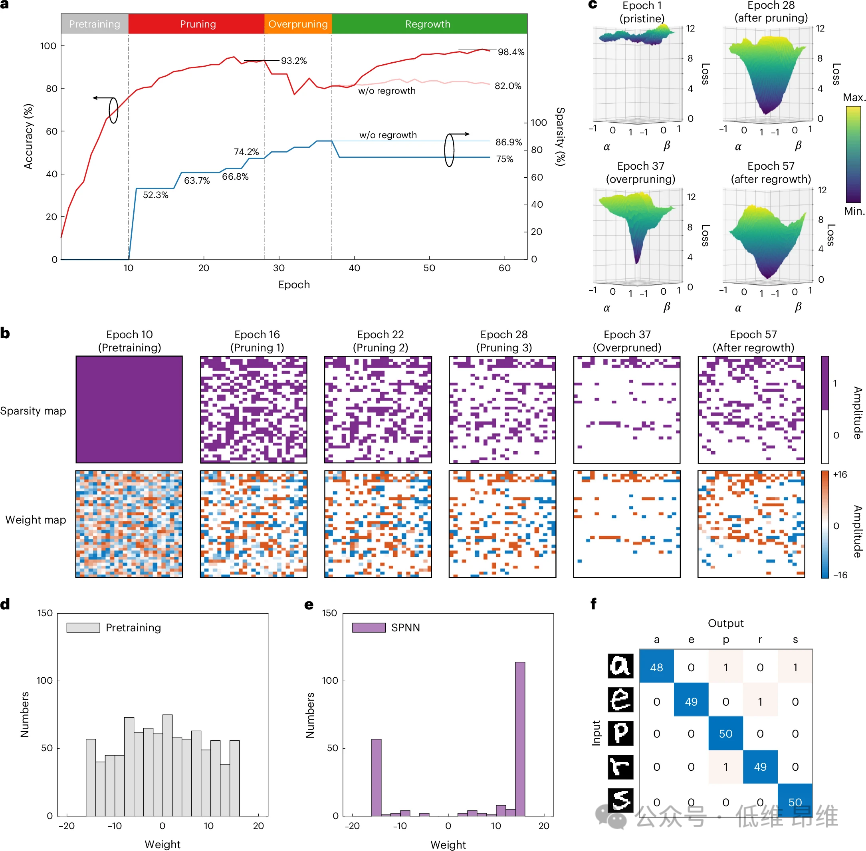

图4|在硬件上训练无索引MSNet。a、训练过程中测量的精度曲线和稀疏度曲线。前十个时期(预训练阶段)由软件生成,而随后的时期(修剪、过度修剪和再生)则由实验数据获得。b、硬件上稀疏图和权重图在六个关键阶段的演变:预训练(第10阶段)、三次修剪(第16、22和28阶段)、过度修剪(第37阶段)和再生后(第57阶段)。颜色图例显示了稀疏数和权重的幅度。c、四个时代(1、28、37和57)的损失景观;α和β是随机生成的方向向量,用于可视化高维损失空间(方法)。颜色图例显示了每个相应时代的不同最大值和最小值。d、预训练后(第10阶段)的权重分布。e、训练后的体重分布(第57阶段)。f、历元57分类结果的混淆矩阵。

图5 |性能预测和基准测试。a、训练后SPNN和密集NN(对照)的权重分布。仿真中使用的网络是VGG8-Net。所有权重值都归一化到范围[-1,1]。b、密集神经网络和SPNN中每一层的权重数和稀疏度。插图:第1层和第8层中的权重数字的放大视图。c、密集神经网络、带外部索引的SPNN和无索引SPNN的准确性、延迟和能量基准(这项工作)。

【结论与展望】

本文提出了一种创新的无索引稀疏神经网络(SPNN)硬件架构,该架构通过将稀疏性信息直接存储在突触单元内部,实现了无需外部索引的稀疏计算。这一设计显著减少了稀疏计算过程中的能量消耗和延迟,提高了神经网络硬件的效率。为了实现这一架构,我们开发了一种基于二维半导体铁电场效应晶体管(FeFET)的紧凑构建模块,其中两个FeFET分别用于存储稀疏性信息和模拟权重值。通过硬件、算法和训练调度的协同优化,我们在实验中实现了在75%稀疏性下98.4%的准确率,同时在大型神经网络的仿真中展示了相对于密集神经网络和带外部索引的SPNN在延迟和能耗上的显著优势。

未来无索引稀疏神经网络的发展方向将聚焦于硬件与算法的深度融合与优化。一方面,需进一步优化FeFET器件的性能,提高器件的集成度和稳定性,降低制造成本,以推动无索引SPNN的实用化进程。另一方面,需深入研究算法与硬件架构的协同优化机制,开发更加高效、灵活的稀疏神经网络训练算法和推理策略。探索无索引SPNN在更多实际应用场景中的潜力,如图像识别、语音识别等,将为其发展提供更为广阔的空间。无索引稀疏神经网络有望成为实现高效、低功耗人工智能应用的关键技术之一,为人工智能的可持续发展注入新的活力。

【论文信息】

Ning, H., Wen, H., Meng, Y. et al. An index-free sparse neural network using two-dimensional semiconductor ferroelectric field-effect transistors. Nat Electron (2025). https://doi.org/10.1038/s41928-024-01328-4

上海昂维科技有限公司现提供二维材料单晶和薄膜等耗材,器件和光刻掩膜版定制等微纳加工服务,以及各种测试分析,欢迎各位老师和同学咨询,竭诚做好每一份服务。